本文介绍了tensorflow完成多项式回归。

数据说明:

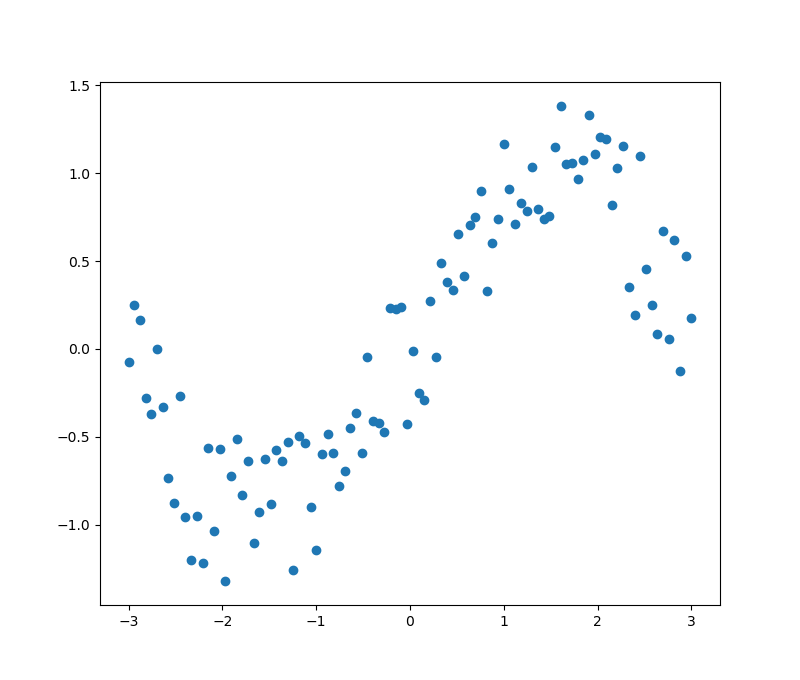

本文使用的训练集,X为随机的100个数字,Y为X的sin值,样本点均为自动生成。我们的目的是拟合一条多项式曲线Y = W_3 * X^3 + W_2 * X^2 + WX + b,使这条曲线能够在此模型的基础上,给定一个新的x,预测它的y值。下图为我们的样本数据点。

文章目录

头文件导入

import numpy as np

import tensorflow as tf

生成训练数据

这里我们X生成[-3, 3]连续的100个点。Y = sin(X),他们是一一对应关系。同时为了保证Y更加离散,我们加入np.random.uniform(-0.5, 0.5, n_observations)。它的功能是,在[-0.5, 0.5]之间生成100个满足均匀分布的数。

n_observations = 100

xs = np.linspace(-3, 3, n_observations)

ys = np.sin(xs) + np.random.uniform(-0.5, 0.5, n_observations) # 求sin,后面的是随机的扰动

准备placeholder占位符

这里,我们使用placeholder占位符。

X = tf.placeholder(tf.float32, name = 'X')

Y = tf.placeholder(tf.float32, name = 'Y')

随机初始化参数权重

这里的W,W_2,W_3和b我们定义成变量,其中tf.random_normal([1])的功能是,总高斯分布中随机取出一个数值。因为初始的权重是随机的,我们正要训练它。

W = tf.Variable(tf.random_normal([1]), name = 'weight')

W_2 = tf.Variable(tf.random_normal([1]), name = 'weight_2')

W_3 = tf.Variable(tf.random_normal([1]), name = 'weight_3')

b = tf.Variable(tf.random_normal([1]), name = 'bias')

建立模型

最终我们建立的模型为Y = W_3 * X^3 + W_2 * X^2 + WX + b

# 列出 Y = WX + b

Y_pred = tf.add(tf.multiply(W, X), b)

# 添加高次项

Y_pred = tf.add(tf.multiply(tf.pow(X, 2), W_2), Y_pred)

Y_pred = tf.add(tf.multiply(tf.pow(X, 3), W_3), Y_pred)

建立损失函数模型

这里使用的是均方误差函数

sample_num = xs.shape[0]

loss = tf.reduce_sum(tf.pow(Y_pred - Y, 2)) / sample_num

初始化optimizer

optimizer是经过优化算法,找到的最优点。这里,我们使用学习率为0.01(即每次迭代的步长),使用的最优解算法为随机梯度下降。

learning_rate = 0.01

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss)

训练模型

训练模型我们需要完成步:

- 将我们的训练集传入模型中

- 使用这些训练集,通过optimizer提供的最优化算法,将loss损失函数迭代最小

需要注意的是:

- 在使用变量之前,需要进行初始化

- 我们需要填充placeholder的值。我们进行多次迭代,tensorflow会根据placeholder传值情况,找到需要训练的变量。

# 指定迭代的次数,并在session中执行graph

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init) # 初始化所有变量

writer = tf.summary.FileWriter('./graph', sess.graph) # 写入tensorboard

# 模型训练

for i in range(1000):

total_loss = 0

for x, y in zip(xs, ys):

_optimizer, _loss = sess.run([optimizer, loss], {X: x, Y: y})

total_loss += _loss

if i % 20 == 0:

print('Epoch {index}: {total_loss}'.format(index = i, total_loss = total_loss))

writer.close() # 关闭writer

# 经过各个算子计算,可以取出训练好的W和b的值

W, W_2, W_3, b = sess.run([W, W_2, W_3, b])

输出我们训练好的模型参数

# 输出W W_2 W_3 b

print('W:' + str(W[0]))

print('W_2:' + str(W_2[0]))

print('W_3:' + str(W_3[0]))

print('b:' + str(b[0]))

完整代码

(这里,因为在Linux服务器上跑,注释掉了部分绘图的函数)

#!usr/bin/python

# -*- coding: UTF-8 -*-

# 多项式回归

import numpy as np

import tensorflow as tf

# import matplotlib.pyplot as plt

# plt.rcParams['figure.figsize'] = {14, 8} # 输出图形的长和宽

n_observations = 100

xs = np.linspace(-3, 3, n_observations)

ys = np.sin(xs) + np.random.uniform(-0.5, 0.5, n_observations) # 求sin,后面的是随机的扰动

# 做一个散点图的扰动

# plt.scatter(xs, ys)

# print(plt.show())

# 准备好placeholder占位符

X = tf.placeholder(tf.float32, name = 'X')

Y = tf.placeholder(tf.float32, name = 'Y')

# 随机初始化参数/权重(这里使用高斯分布)

W = tf.Variable(tf.random_normal([1]), name = 'weight')

W_2 = tf.Variable(tf.random_normal([1]), name = 'weight_2')

W_3 = tf.Variable(tf.random_normal([1]), name = 'weight_3')

b = tf.Variable(tf.random_normal([1]), name = 'bias')

# 计算预测结果 列出 Y = WX + b

Y_pred = tf.add(tf.multiply(W, X), b)

# 添加高次项

Y_pred = tf.add(tf.multiply(tf.pow(X, 2), W_2), Y_pred)

Y_pred = tf.add(tf.multiply(tf.pow(X, 3), W_3), Y_pred)

# 计算损失函数 均方误差函数

sample_num = xs.shape[0]

loss = tf.reduce_sum(tf.pow(Y_pred - Y, 2)) / sample_num

# 初始化optimizer

learning_rate = 0.01

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss)

# 指定迭代的次数,并在session中执行graph

init = tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init) # 初始化所有变量

writer = tf.summary.FileWriter('./graph', sess.graph) # 写入tensorboard

# 模型训练

for i in range(1000):

total_loss = 0

for x, y in zip(xs, ys):

_optimizer, _loss = sess.run([optimizer, loss], {X: x, Y: y})

total_loss += _loss

if i % 20 == 0:

print('Epoch {index}: {total_loss}'.format(index = i, total_loss = total_loss))

writer.close() # 关闭writer

# 经过各个算子计算,可以取出训练好的W和b的值

W, W_2, W_3, b = sess.run([W, W_2, W_3, b])

# 输出W W_2 W_3 b

print('W:' + str(W[0]))

print('W_2:' + str(W_2[0]))

print('W_3:' + str(W_3[0]))

print('b:' + str(b[0]))

# 画图 他是sin的泰勒展开

# plt.plot(xs, ys, 'bo', label = 'Real data')

# plt.plot(xs, xs * W + np.power(xs, 2) * W_2 + np.power(xs, 3) * W_3 + b, 'r', label = 'Predicted data')

# plt.legend()

# plt.show()

版权声明:本文内容由互联网用户自发贡献,该文观点与技术仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 [email protected] 举报,一经查实,本站将立刻删除。