目录

2、永久关闭 sed -i '/swap/d' /etc/fstab

(2) for i in 2 3;do scp /etc/yum.repos.d/kubernetes.repo hd${i}.com:/etc/yum.repos.d/;done

(三)重载启动脚本及docker程序(在三个节点上分别执行)

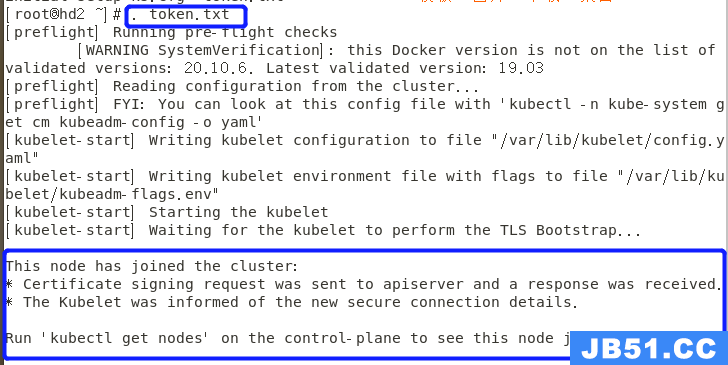

2、. token.txt该命令执行成功界面(在node1、node2上操作)

(2)将Docker镜像busybox加载到本地Docker引擎中。

一、环境设置

| 角色 |

IP地址 |

主机名 |

| master |

192.168.115.11/24 |

hd1.com |

| node1 |

192.168.115.12/24 |

hd2.com |

| node2 |

192.168.115.13/24 |

hd3.com |

| 注意:每台主机运行内存至少设置为4GB,处理器设为两核 | ||

二、基本环境配置

(一)主机名配置

1、在master虚拟机上操作

hostnamectl set-hostname hd1.com && bash

2、在node1r虚拟机上操作

hostnamectl set-hostname hd2.com && bash

3、在node2虚拟机上操作

hostnamectl set-hostname hd2.com && bash

(二)VMware网络配置

更改网卡为NAT模式并调整为分配192.168.115.0/24网段地址

(三)虚拟机网络配置

1、在master虚拟机上操作

systemctl stop NetworkManager

systemctl disable NetworkManager

vim /etc/sysconfig/network-scripts/ifcfg-ens33

TYPE=Ethernet

BOOTPROTO=static

NAME=ens33

DEVICE=ens33

ONBOOT=yes

IPADDR=192.168.115.11

PREFIX=24

GATEWAY=192.168.115.2

DNS1=192.168.115.2

2、在node1r虚拟机上操作

systemctl stop NetworkManager

systemctl disable NetworkManager

vim /etc/sysconfig/network-scripts/ifcfg-ens33

TYPE=Ethernet

BOOTPROTO=static

NAME=ens33

DEVICE=ens33

ONBOOT=yes

IPADDR=192.168.115.12

PREFIX=24

GATEWAY=192.168.115.2

DNS1=192.168.115.2

3、在node2虚拟机上操作

systemctl stop NetworkManager

systemctl disable NetworkManager

vim /etc/sysconfig/network-scripts/ifcfg-ens33 #手动配置IP地址

TYPE=Ethernet

BOOTPROTO=static

NAME=ens33

DEVICE=ens33

ONBOOT=yes

IPADDR=192.168.115.13

PREFIX=24

GATEWAY=192.168.115.2

DNS1=192.168.115.2

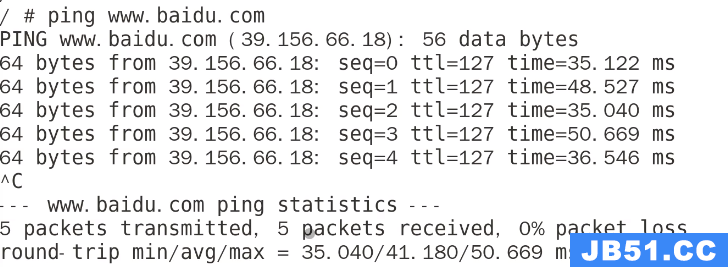

4、虚拟机内部测试

ping www.baidu.com #需在三个节点上都要进行测试

(四)修改hosts文件(在三个节点上分别执行)

vim /etc/hosts

192.168.115.11 hd1.com

192.168.115.12 hd2.com

192.168.115.13 hd3.com

测试:ping hd1.com && ping hd2.com && ping hd3.com #需在三个节点上都要进行测试

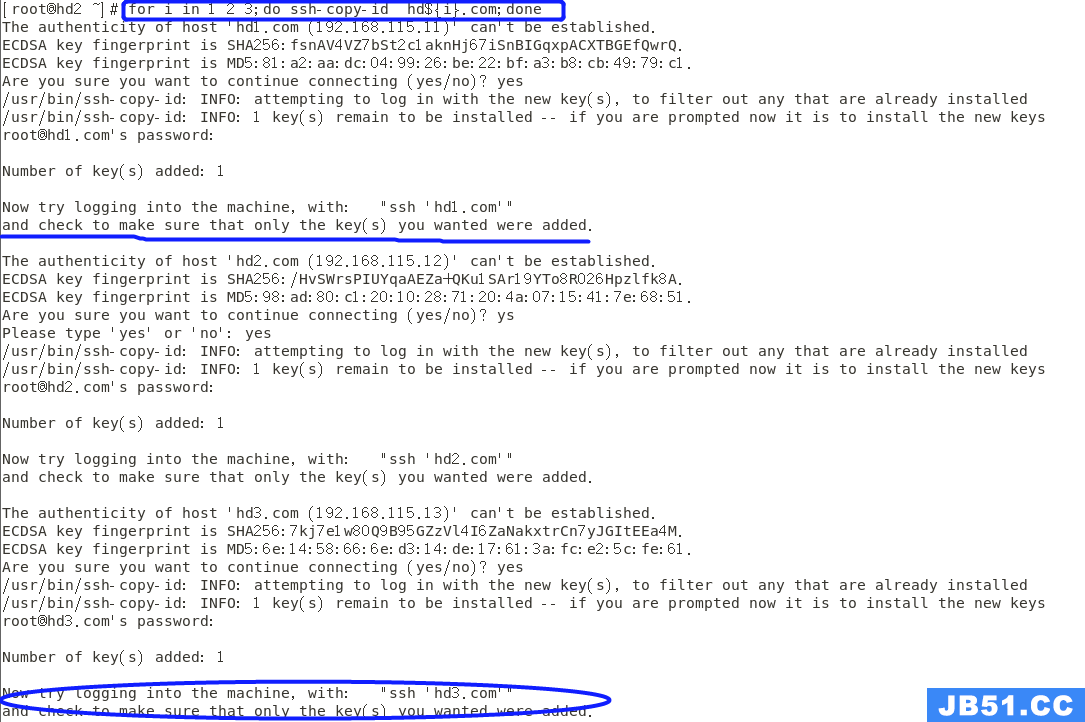

(五)配置SSH免密登录(在三个节点上分别执行)

ssh-keygen

for i in 1 2 3;do ssh-copy-id hd${i}.com;done

测试:ssh hd1.com ssh hd2.com ssh hd3.com #需在三个节点上都要进行测试

(六)关闭防火墙及SELINUX(在三个节点上分别执行)

systemctl stop firewalld && systemctl disable firewalld && setenforce 0 && sed -i 's/SELINUX=enforcing/SELINUX=disabled/' /etc/selinux/config

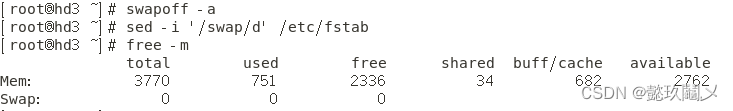

(七)关闭swap分区(三个节点上分别执行)

1、临时关闭 swapoff -a

2、永久关闭 sed -i '/swap/d' /etc/fstab

3、测试:free,发现swap全为0

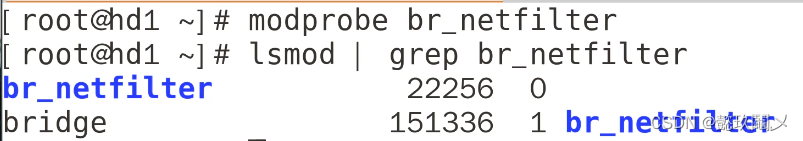

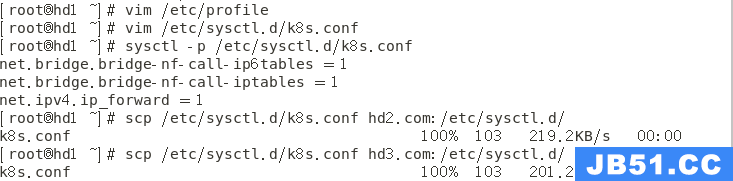

(八)修改内核参数(在三个节点上分别执行)

modprobe br_netfilter && echo "modprobe br_netfilter" >> /etc/profile && echo -e "net.bridge.bridge-nf-call-ip6tables = 1\nnet.bridge.bridge-nf-call-iptables = 1\nnet.ipv4.ip_forward = 1\n" > /etc/sysctl.d/k8s.conf && sysctl -p /etc/sysctl.d/k8s.conf

(九)配置时间同步

for i in 1 2 3;do ssh hd${i}.com yum install -y ntpdate && ntpdate cn.pool.ntp.org;done

(十)加载ip_vs模块(在三个节点上分别执行)

#ipvs.modules可以在资源中查找到

for i in 1 2 3;do scp /root/ipvs.modules hd${i}.com:/etc/sysconfig/modules/ && ssh hd${i}.com bash /etc/sysconfig/modules/ipvs.modules && lsmod | grep ip_vs && echo -e "-----------------------------\nhd${i}.com";done

echo -e "-----------------------------\nhd${i}.com":在远程主机的输出结果之后,显示分隔线和远程主机的名称。

(十一)配置源

1、在三个节点上分别执行

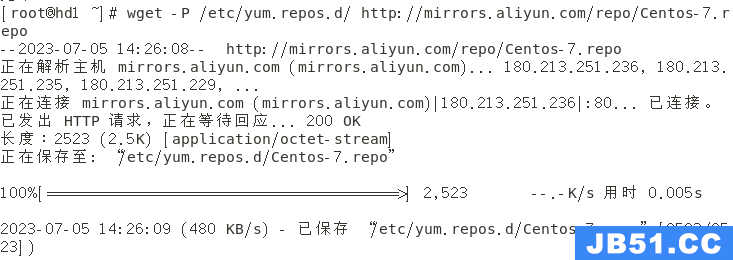

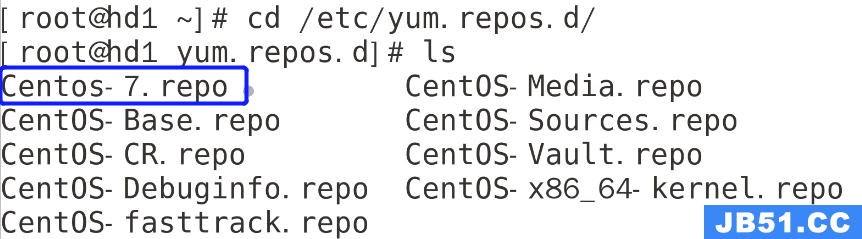

(1) yum install lrzsz openssh-clients -y > /dev/null && wget -P /etc/yum.repos.d/ http://mirrors.aliyun.com/repo/Centos-7.repo && ls -l /etc/yum.repos.d/Centos-7.repo

![]()

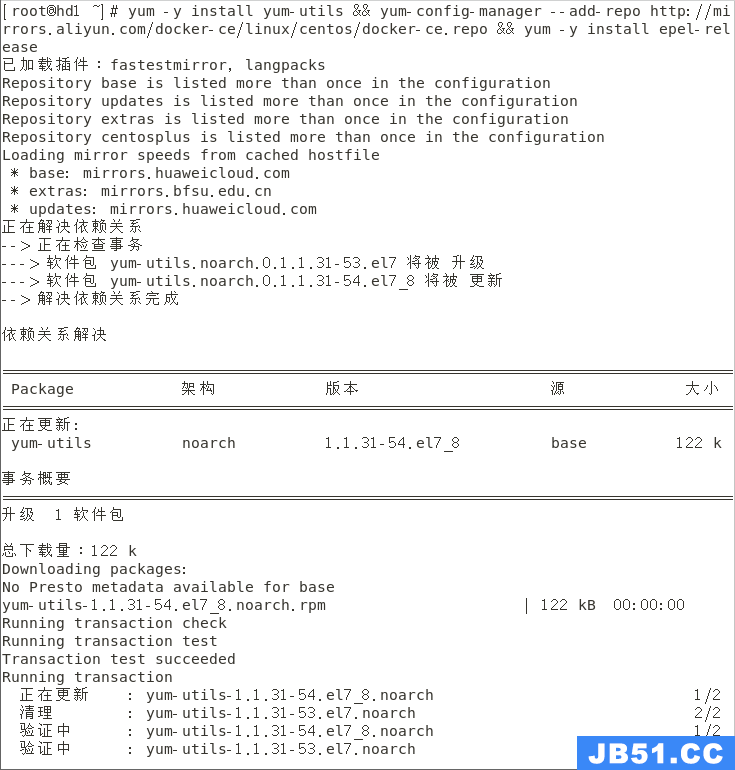

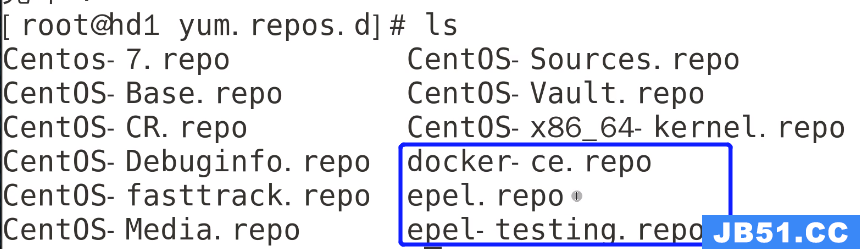

(2) yum -y install yum-utils && yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo && yum -y install epel-release

2、在master上操作

(1)echo -e "[kubernetes]\nname=Kubernetes\nbaseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/\nenabled=1\ngpgcheck=0" > /etc/yum.repos.d/kubernetes.repo

(2) for i in 2 3;do scp /etc/yum.repos.d/kubernetes.repo hd${i}.com:/etc/yum.repos.d/;done

(十二)安装依赖(在三个节点上分别执行)

yum install -y yum-utils device-mapper-persistent-data lvm2 wget net-tools nfs-utils lrzsz gcc gcc-c++ make cmake libxml2-devel openssl-devel curl curl-devel unzip sudo ntp libaio-devel wget vim ncurses-devel autoconf automake zlib-devel python-devel epel-release openssh-server socat conntrack ntpdate telnet ipvsadm

三、docker-ce

(一)在三个节点上分别执行安装

yum install docker-ce-20.10.6 docker-ce-cli-20.10.6 containerd.io -y && systemctl start docker && systemctl enable docker.service

(二)配置仓库加速

vim /root/daemon.json

{

"registry-mirrors":["https://rsbud4vc.mirror.aliyuncs.com","https://registry.docker-cn.com","https://docker.mirrors.ustc.edu.cn","https://dockerhub.azk8s.cn","http://hub-mirror.c.163.com","http://qtid6917.mirror.aliyuncs.com","https://rncxm540.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"]

}

(三)重载启动脚本及docker程序(在三个节点上分别执行)

systemctl daemon-reload

systemctl restart docker

四、安装kubernetes

(一)安装初始化软件(在三个节点上分别执行)

yum install -y kubelet-1.20.6 kubeadm-1.20.6 kubectl-1.20.6

(二)启动并查看状态(在三个节点上分别执行)

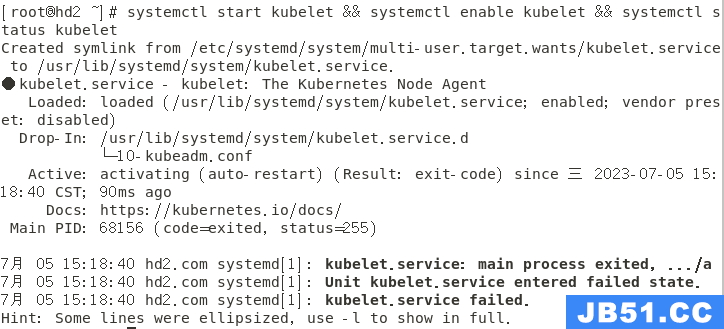

systemctl start kubelet && systemctl enable kubelet && systemctl status kubelet

(三)拷贝k8s镜像(在master操作)

for i in 2 3;do scp k8simage-1-20-6.tar.gz hd${i}.com:/root/;done

(四)加载k8s的docker镜像

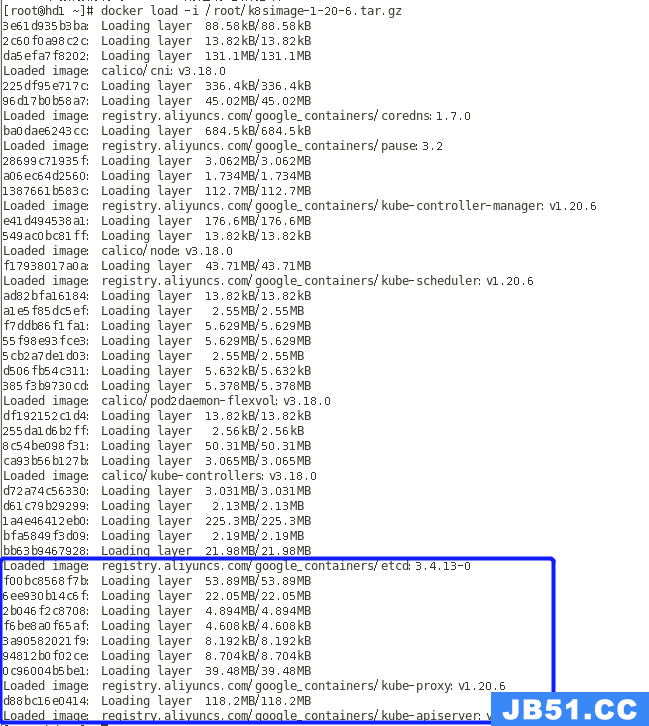

for i in 1 2 3;do ssh hd${i}.com docker load -i /root/k8simage-1-20-6.tar.gz;done

验证:docker images(在三个节点上分别执行)

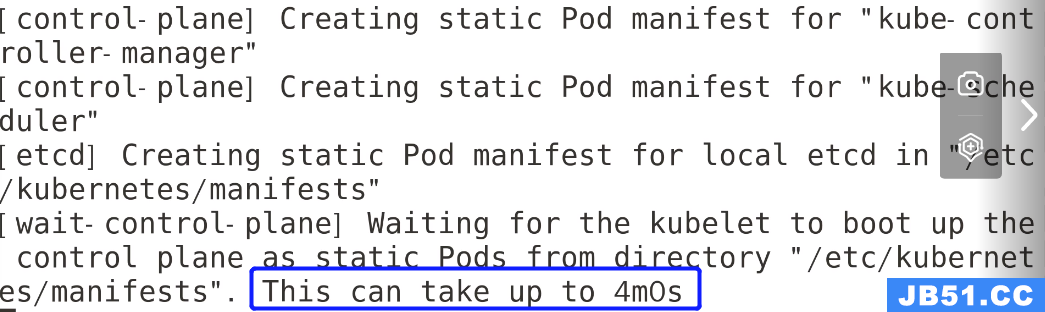

(五)初始化集群(在master操作)

1、kubeadm init --kubernetes-version=1.20.6 --apiserver-advertise-address=192.168.115.11 --image-repository registry.aliyuncs.com/google_containers --pod-network-cidr=10.244.0.0/16 --ignore-preflight-errors=SystemVerification

2、假如失败,进行回滚

kubeadm reset

3、成功后复制token信息

vim token.txt

4、 假如忘记复制token信息

kubeadm token create --print-join-command

5、拷贝配置文件

mkdir -p $HOME/.kube

cp /etc/kubernetes/admin.conf $HOME/.kube/config

6、查看节点状态

kubectl get nodes

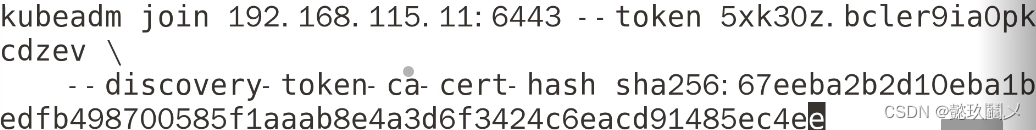

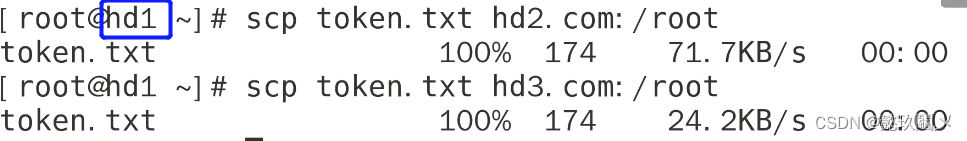

(六)将node加入集群(在node1、node2上操作)

1、远程拷贝token.txt

2、. token.txt该命令执行成功界面(在node1、node2上操作)

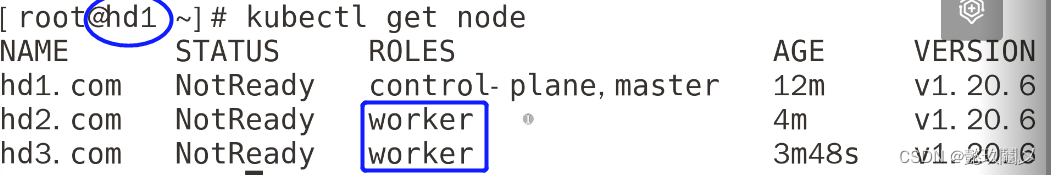

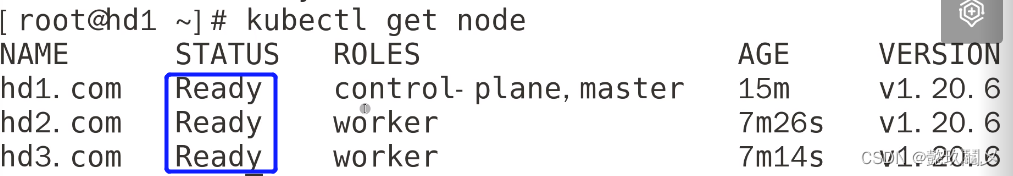

3、在控制节点上(master)验证

kubectl get node

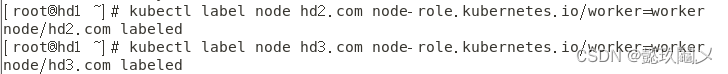

(七)定义node角色(在master操作)

kubectl label node hd2.com node-role.kubernetes.io/worker=worker

kubectl label node hd3.com node-role.kubernetes.io/worker=worker

验证:kubectl get node

(八)安装网络组件

1、拷贝calico.yaml至master节点

2、在master,hd1.com执行

kubectl apply -f calico.yaml

3、验证:kubectl get node

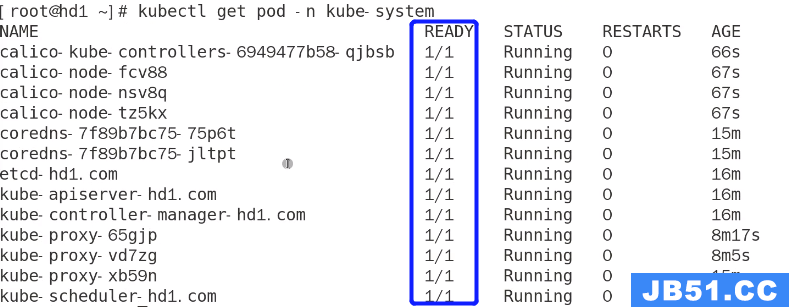

(九)验证集群

1、查看集群状态

kubectl get pod -n kube-system

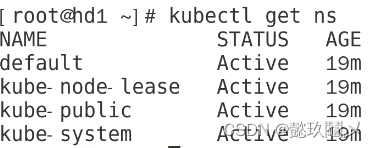

2、查看名称空间

kubectl get namespace 命令简写:kubectl get ns

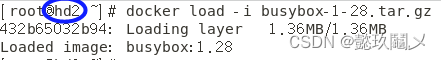

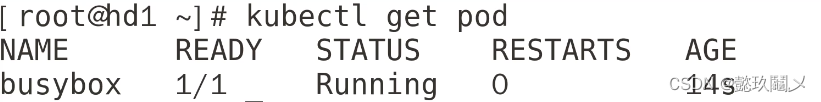

3、使用busybox镜像验证网络通信

(1)拷贝busybox包到master

(2)将Docker镜像busybox加载到本地Docker引擎中。

for i in 2 3;do scp busybox-1-28.tar.gz hd${i}.com:/root/ && ssh hd${i}.com docker load -i /root/busybox-1-28.tar.gz;done

(3)启动busybox并进入

kubectl run busybox --image=busybox:1.28 --restart=Never --rm -it busybox -- sh

原文地址:https://blog.csdn.net/wuds_158/article/details/131568554

版权声明:本文内容由互联网用户自发贡献,该文观点与技术仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 dio@foxmail.com 举报,一经查实,本站将立刻删除。