文章目录

MicrosK8s介绍

MicroK8s 是一个经过 CNCF 认证的轻量级的 Kubernetes开源部署工具,用于自动化部署、扩展和管理容器化应用程序。它在一个小的占用空间中提供了核心 Kubernetes 组件的功能,使其可以从单个节点扩展到高可用性生产集群。MicroK8s 是一个单一的软件包,使开发人员能够在

60秒内获得功能齐全、一致且安全的 Kubernetes 系统。

版本选择

- 虚拟机系统: Ubuntu: 22.04 LTS(建议,官网默认教程是用Ubuntu,也支持其他Linux系统,可以查看后面官网链接)

- MicroK8s: 1.23以上(MicroK8s version对应的就是Kubernetes Version)

- 虚拟机: Parallels Desktop 18.1.1

- 宿主机器: 我的笔记本是MacOS M2 13.2.1 (22D68)

- 每台虚拟机需要2CPU2G内存

准备三台虚拟机

这里虚拟机安装就不说了,网上很多,如果使用Parallels Desktop的朋友可以直接用Parallels自带的安装工具点击Unbuntu,就会自动安装最新版本。

这里我把用来做K8s集群的三台虚拟机分别划分为 Master(m)、Worker 1(w1)、Worker 2(w2),大家在本文后面的内容会看到类似的名字。

建议先在虚拟机安装net-tool,后面需要用来查ip可能用到

sudo apt-get update

sudo apt-get install net-tools

分别在三台虚拟机修改hostname,这一步可选,因为本文暂时用不到,但是避免大家因为域名问题导致集群节点出现奇奇怪怪访问受限问题

Master

sudo hostnamectl set-hostname m

sudo vi /etc/hosts

192.168.50.97 m

192.168.50.99 w1

192.168.50.163 w2

Worker 1

sudo hostnamectl set-hostname w1

sudo vi /etc/hosts

192.168.50.97 m

192.168.50.99 w1

192.168.50.163 w2

Worker 2

sudo hostnamectl set-hostname w2

sudo vi /etc/hosts

192.168.50.97 m

192.168.50.99 w1

192.168.50.163 w2

以上设置完全后,每个几点互相之前应该都可以通过新的hostname访问,可以互相ping下,测试链接

ping m

ping w1

ping w2

搭建MicroK8s环境

参考: 官方文档

注意: 在国内如果直接按官网文档安装,因为网络问题可能会有坑。我调整了下步骤,以下需要在三台虚拟机操作同样的步骤,配置相同的运行环境。注意这里要想安装成功,必须要让你的虚拟机

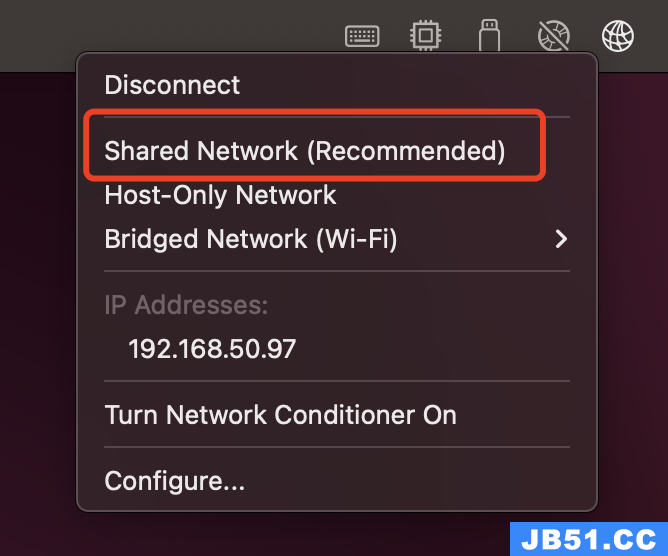

可以科学上网,这个很重要!!!如果大家用Parallels,可以在宿主机打开你购买的合法代理,然后虚拟机选择Shared Network,这样虚拟机就可以跟你宿主机共享网络科学上网,进行下载安装,建议一台台虚拟机分开使用Shared Network模式安装,不然可能会出现你几个虚拟机同时使用Shared Network出现IP冲突导致不能顺利下载Microk8s组件。在后面配置集群的时候记得把虚拟机网络切换回Bridge模式,否则你集群节点互相会访问不了。

安装Microk8s

sudo snap install microk8s --classic --channel=1.23/stable

microk8s status --wait-ready

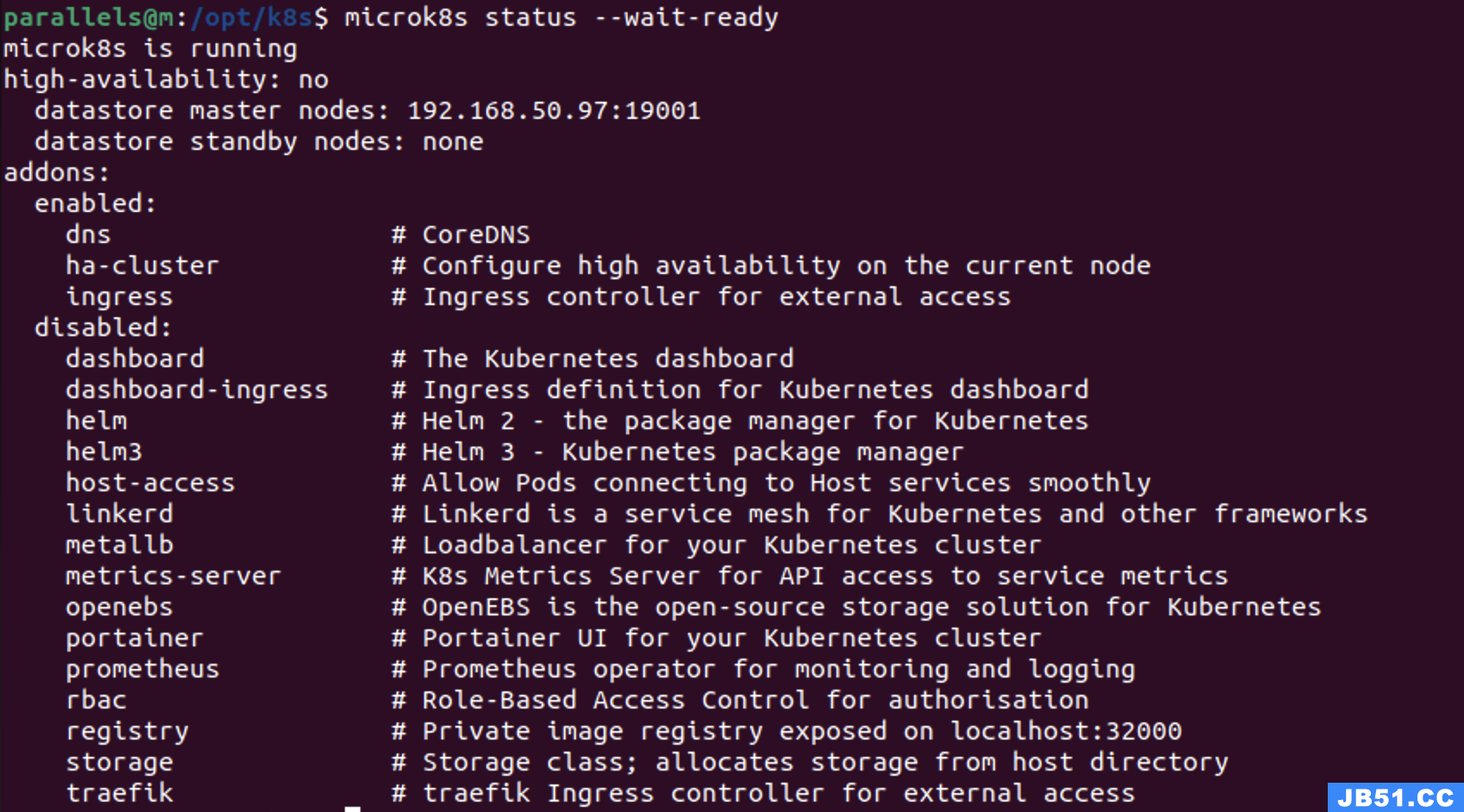

这里安装成功,控制台会有如下信息输出,如果没有输出,意味着安装失败了,可以尝试切换其他版本。默认里面addons插件都是disable的,这里因为我机子已经提前装了,所以显示有enabled的插件。

把当前用户加入Admin Group

这样可以使用当前用户操作Microk8s指令时,拥有admin权限

sudo usermod -a -G microk8s $USER

sudo chown -f -R $USER ~/.kube

su - $USER

访问K8s

MicroK8s已经绑定了K8s原生命令,默认会带有microk8s别名+K8s原生命令去避免与K8s原生命令冲突,所以需要用以下指令去查看K8s状态

microk8s kubectl get nodes

这里以m node为例子,控制台可以看到如下信息:

parallels@m:/opt/k8s$ microk8s kubectl get nodes

NAME STATUS ROLES AGE VERSION

m Ready <none> 13h v1.23.17-2+7a25397bc9bdd6

启动和停止MicroK8s服务

如果有需要停止或者重启MicroK8s,可以使用以下指令。我们并不需要重启服务才能完成microK8s安装,因为可以忽略一下命令。

microk8s stop

microk8s start

到这里三台机完成上面步骤就已经搭建好K8s单机版了,是不是很快呢,接下来我们进行集群搭建!

搭建MicroK8s集群

MicroK8s搭建集群非常简单,只需要让每个worker节点的机子加入到master节点即可。

把Worker节点分别加入到MicroK8s集群

(1)首先先在Master节点输入以下命令

microk8s add-node

控制台会输出一下指令

parallels@m:/opt/k8s$ microk8s add-node

From the node you wish to join to this cluster,run the following:

microk8s join 192.168.50.97:25000/5863a82ebcb27960812a04e0b681d2d9/4b62d7a9ae9b

Use the '--worker' flag to join a node as a worker not running the control plane,eg:

microk8s join 192.168.50.97:25000/5863a82ebcb27960812a04e0b681d2d9/4b62d7a9ae9b --worker

If the node you are adding is not reachable through the default interface you can use one of the following:

microk8s join 192.168.50.97:25000/5863a82ebcb27960812a04e0b681d2d9/4b62d7a9ae9

(2)在Worker 节点执行

把上面生成的指令复制到Worker节点机子运行

192.168.50.97:25000/5863a82ebcb27960812a04e0b681d2d9/4b62d7a9ae9b --worker

这样我们就已经完成了一台机子的集群搭建了,另外一台机子只需要重复(1)、(2)步骤即可。这里值得注意的是microk8s add-node生成的指令只能用于一台Worker node,另外一台机子要加入集群记得需要重新在Master node执行一次,然后再复制到另一台Workder Node执行,因为一份token只能用于一台机子,两台独立的Workder node,需要分别执行,这个很重要!

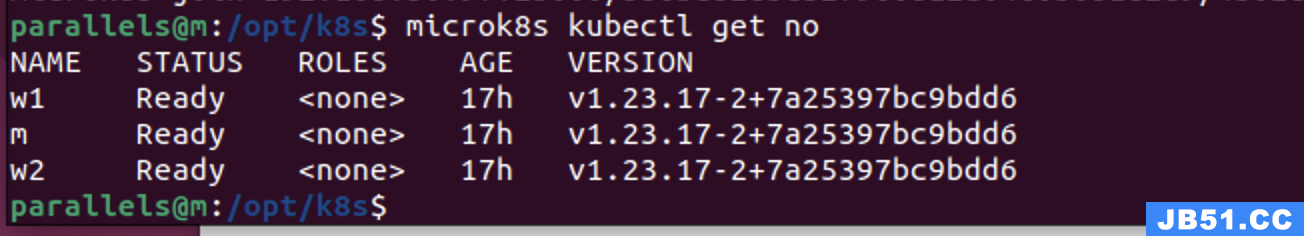

在Master节点检查节点运行情况

在Master节点执行microk8s kubectl get no可以查看集群运行情况,这里可以看到所有集群内的节点都是Ready状态。

在Master节点打开存储插件

集群如果需要持久化数据,这里可以直接输入以下指令把存储插件打开,会自动使用宿主机器进行数据存储。

microk8s enable hostpath-storage

如果想配置集群存储服务(NFS),可以查看后面章节,会单独介绍。

在Master节点打开DNS插件

K8s集群内部DNS服务管理,输入以下指令即可

microk8s enable dns

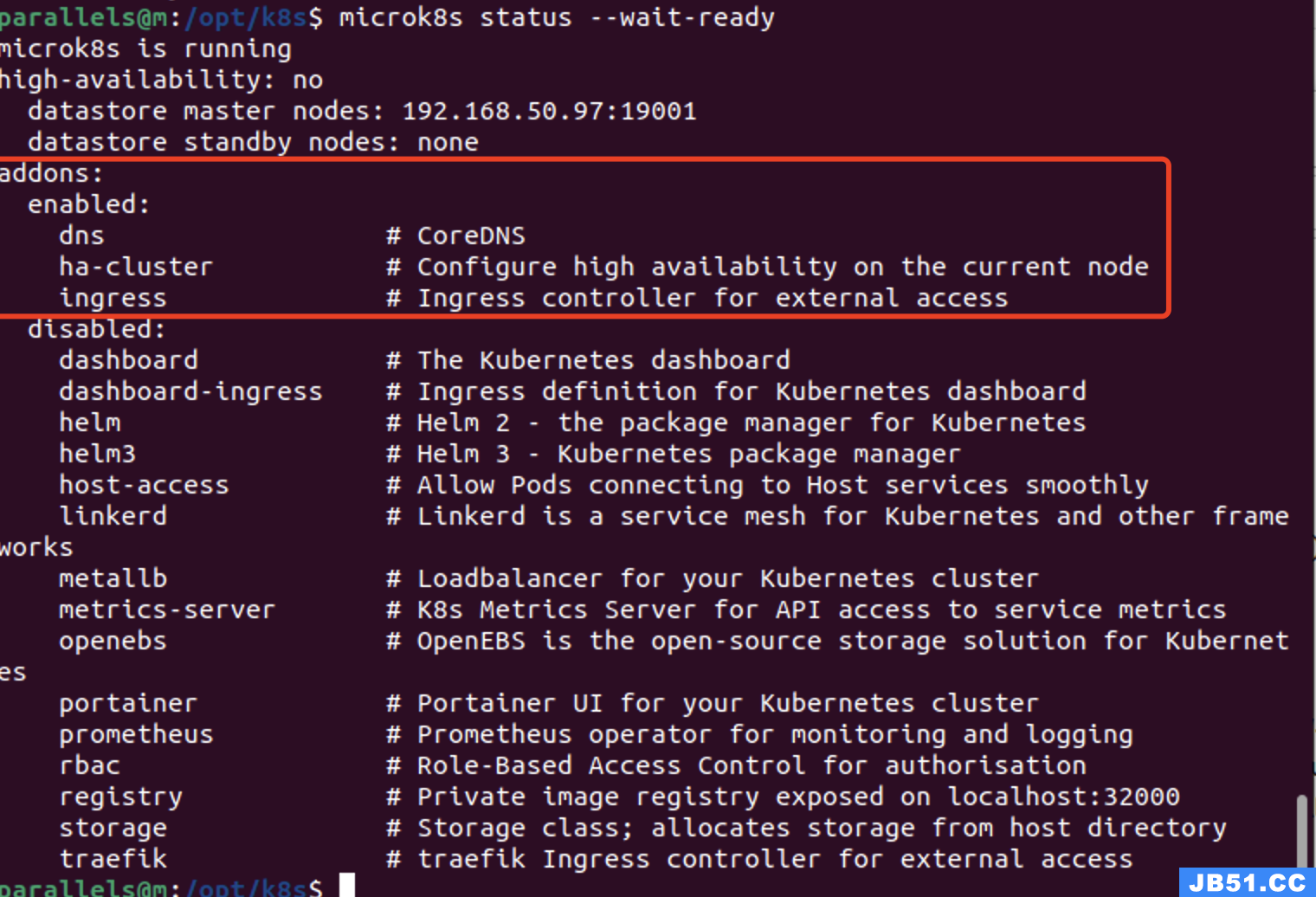

查看K8s插件启用情况

在Master节点输入以下指令,可以查看插件的启用情况:

microk8s status --wait-ready

到这里集群已经搭建完毕!

发布应用到K8s集群

在Master节点部署和运行Nginx

这里只需要在Master节点部署和运行Nginx

microk8s kubectl create deployment nginx --image=nginx

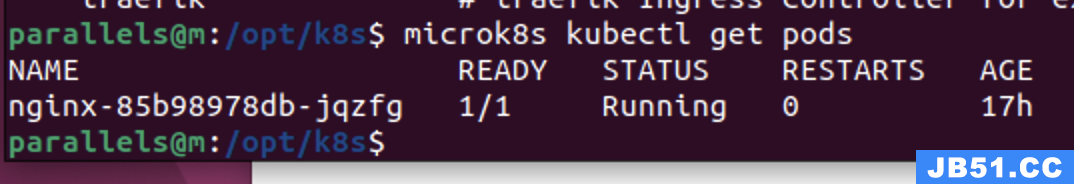

通过一下命令查看Nginx运行情况,这里需要大约1-2分钟才会变成Ready

microk8s kubectl get pods

目前我们的

Nginx Pod虽然已经在运行,但是还没办法访问,我们需要对外发布服务才可以在浏览器访问。

在Master节点发布Nginx

发布K8s服务:

microk8s kubectl expose deployment nginx --type="NodePort" --port 80

成功后,控制台会输出

service/nginx exposed

如果直接访问Master节点IP192.168.50.97,会发现没办法在浏览器访问,因为默认情况下,K8s会将Nginx用到的80端口默认映射到K8s集群的随机端口,通过一下命令可以查看Nginx服务情况:

microk8s kubectl get svc nginx

控制台输出:

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

nginx NodePort 10.152.183.26 <none> 80:30096/TCP 52

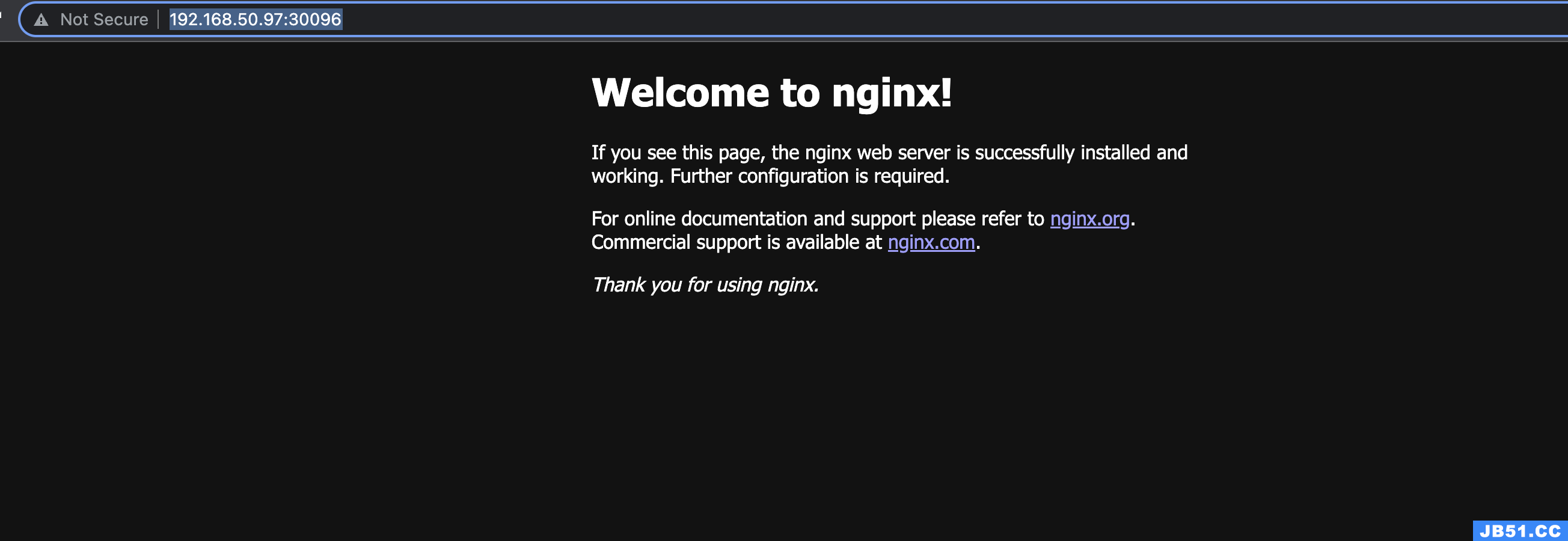

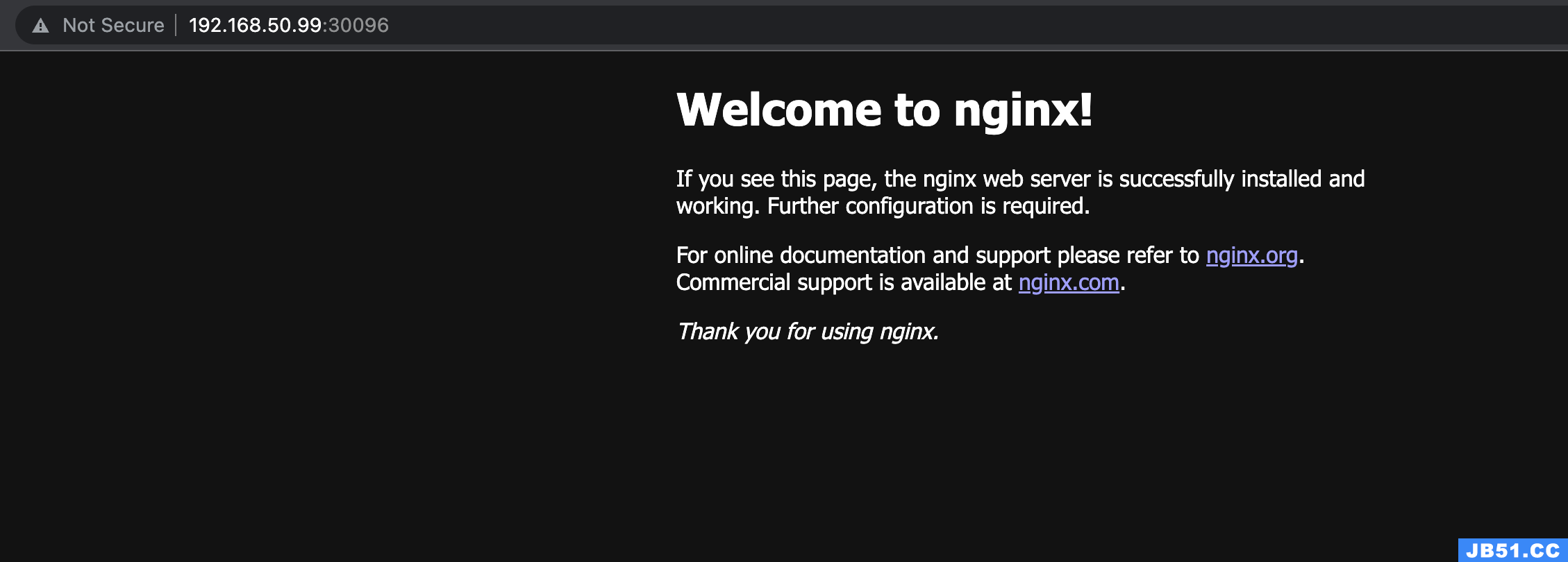

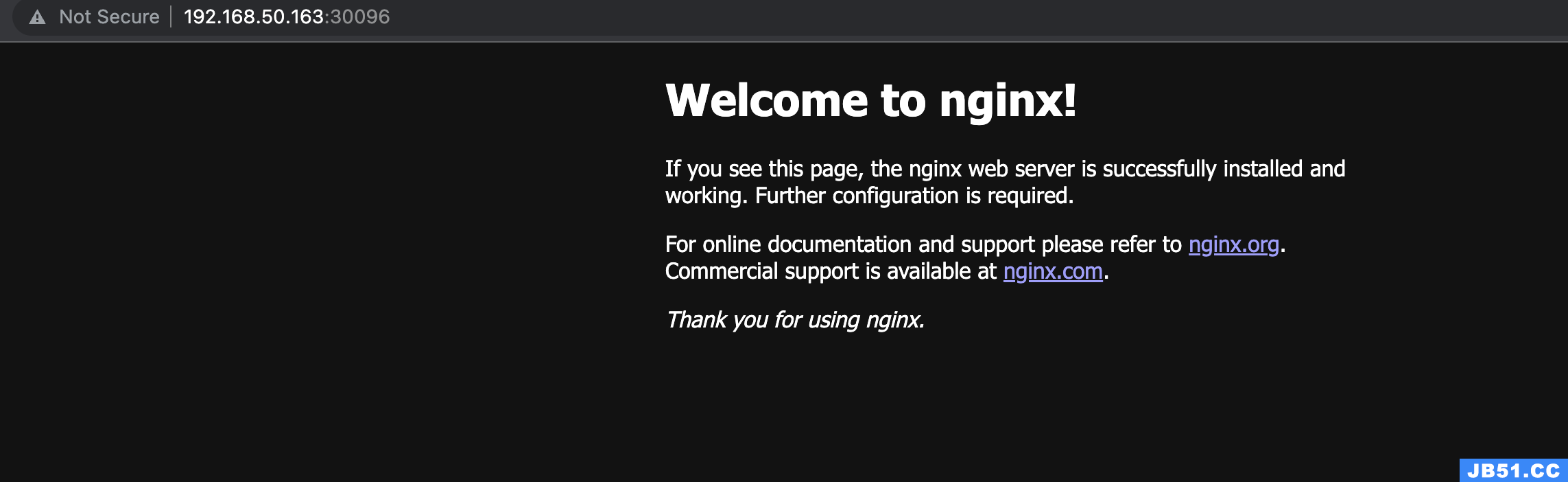

因此,这里的 30096才是K8s集群对外暴露的Nginx访问端口,我们可以在宿主机的浏览器通过{虚拟机IP}:30096访问K8s集群各个节点的30096端口,就可以看到Nginx欢迎页面。

Master IP

Worker 1 IP

Worker2 IP

到这里就全部完成啦,下一章我会介绍怎么使用

NFS Server作为MicroK8s的持久化存储服务

本文Microk8s常用命令总结

1.查看MicroK8s安装状态

microk8s status --wait-ready

2.启动和停止MicroK8s服务

microk8s stop

microk8s start

3.查看集群节点和服务状态

microk8s kubectl get nodes

microk8s kubectl get services

4.修改MicroK8s指令别名

alias kubectl='microk8s kubectl'

5.部署和运行APP

microk8s kubectl create deployment nginx --image=nginx

6.查看Pod运行状态

microk8s kubectl get pods

7.对外发布服务

microk8s kubectl expose deployment nginx --type="NodePort" --port 80

8.查询服务运行状态

microk8s kubectl get svc nginx

9.启用MicroK8s插件

microk8s enable hostpath-storage

10.生成加入集群指令

microk8s add-node

11.退出集群

以下命令在子节点执行

microk8s leave

以下命令在Master节点执行

microk8s remove-node 10.22.254.79

原文地址:https://blog.csdn.net/Evan_Leung/article/details/131225526

版权声明:本文内容由互联网用户自发贡献,该文观点与技术仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 dio@foxmail.com 举报,一经查实,本站将立刻删除。