作者:Timothychao

导语 日志服务CLS是腾讯云提供的一站式日志服务平台,提供了日志采集、存储、检索、图表分析、数据加工、日志投递、监控告警、仪表盘可视化等多项服务,协助用户解决业务运维、运营及审计等多种场景问题。

业务背景

随着云计算技术的发展,越来越多的公司开始向业务更敏捷、成本更低、可伸缩、更灵活的云原生架构转变。而在云原生技术栈中,容器已经成为应用分发和交付的标准技术,将应用与底层运行环境进行解耦;其中 Kubernetes 已经成为容器编排的事实标准,被广泛用于自动部署、扩展和管理容器化应用。

在 Kubernetes 容器应用中,日志采集是非常重要的一环。腾讯云日志服务 CLS 针对 Kubernetes 环境下复杂环境的日志采集设计了完善的解决方案,提升了用户日志存储分析的产品体验。

日志采集新挑战

容器环境下的日志采集对比传统的虚拟机或者物理机有很多不同点,也因为容器更轻量、无状态等特性给日志采集带来了更大的挑战:

- 复杂的日志形式:Kubernetes 首先有多样的日志形式,如审计日志、事件日志等;除此以外业务日志还分为两类:stdout 标准输出,文件日志。

- 复杂的动态环境:Kubernetes 环境的弹性伸缩给日志采集带来了很大的困难,传统的采集配置在容器环境缺乏动态匹配的能力,无法精准灵活适配;同时多层级的筛选匹配规则也容易造成偏差和混淆。

- 更高的可靠性要求:在 Kubernetes 中,机器的宕机、下线、上线、Pod 销毁、扩容/缩容等都是常态,需要保证日志采集的高实时性,保障数据不丢失。

- 更高的采集性能要求:一般规格稍大的节点,可能包含几十甚至上百个容器。如何在资源有限的情况下保障大量容器的采集,这也对采集器的性能提出了更高的要求。

- 云原生 Devops 的集成挑战:成熟的云原生架构会在 Kubernetes 上搭建一套 CICD 系统,自动化地完成业务集成和部署,日志作为运维的关键系统也需符合这套流程,但这也造成原有独立系统改造困难。

解决方案

LogListener 是腾讯云日志服务 CLS 提供的日志采集客户端,它按照预设的采集策略实时上报日志数据。

面对容器环境,CLS 在 LogListener 原有的日志采集基础上增加了容器环境交互的组件,共同组成容器采集的 Log-agent,配合完成复杂场景的日志采集。LogListener 具备解决容器环境挑战的多种能力:

- 复杂的日志形式---支持多种采集源+解析方式,满足全部容器日志场景需求;

- 复杂的动态环境---分别针对容器集群、采集端、服务端维护独立组件,并通过 agent 联通组合,保障采集配置的生效和正确更新;

- 更高的可靠性要求---在采集时提前预读文件,实现文件删除场景下持续采集,解决 Pod 销毁后日志漏采问题;

- 更高的采集性能要求---使用多线程版本提升采集性能,满足大集群下的采集性能需求;

- 云原生 Devops 的集成挑战---全步骤支持使用 CRD 配置,将日志服务融入自动化流程。

架构设计

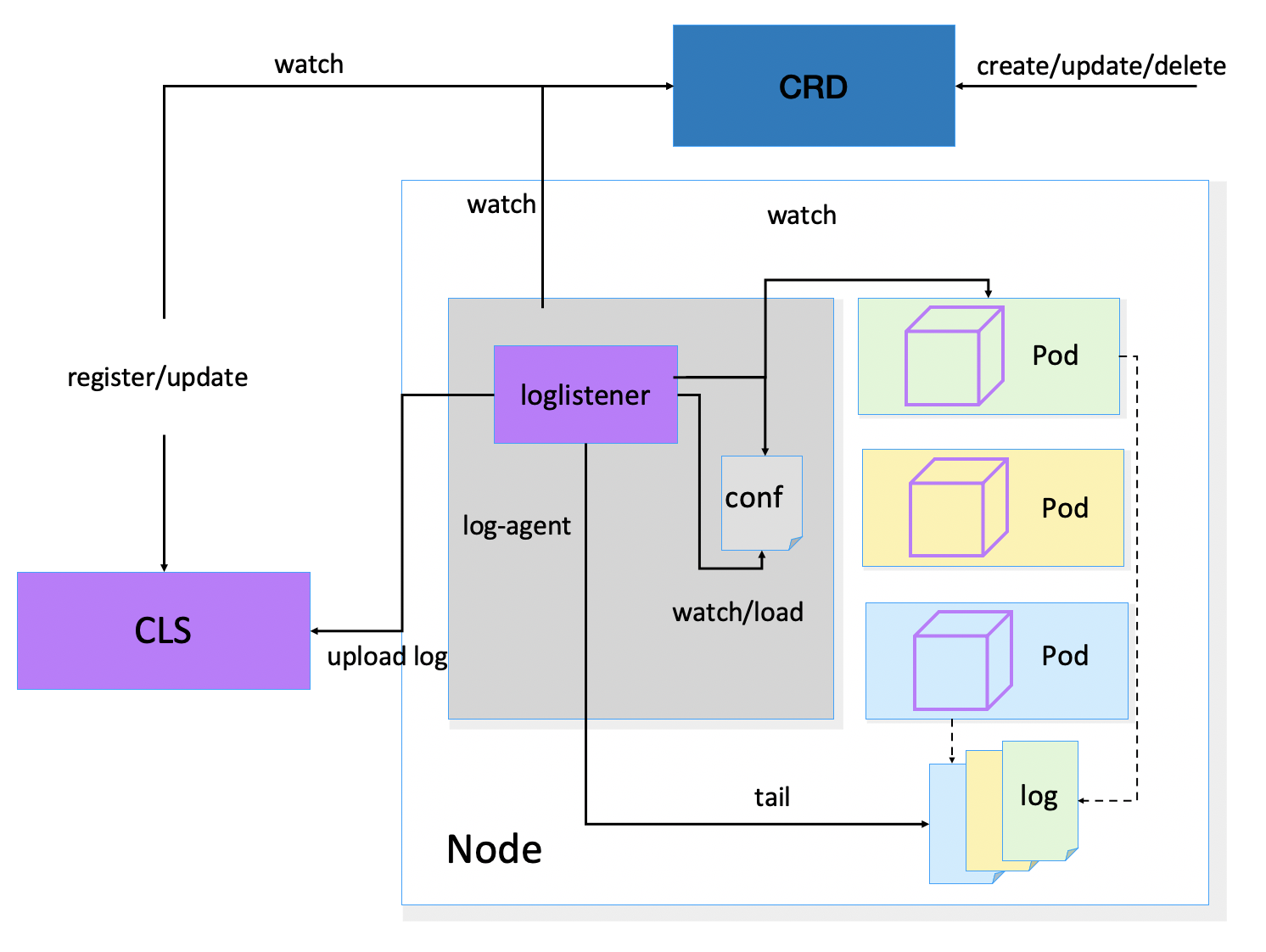

CLS 的日志采集 Agent 会在集群内以 DaemonSet 形式运行,并根据用户通过日志采集规则配置的采集源、CLS 日志主题和日志解析方式,从采集源进行采集,将日志内容发送到消费端。

(1)CLS 服务端:建立 Log-agent;

(2)Log-agent:监听集群 CRD 和本节点 Pod 并计算采集路径;

(3)LogListener:自研高性能采集器,负责日志采集。

【运作流程】

- 首先需要在 CLS 上创建机器组,对应容器环境内待采集的容器;

- 按照定义的采集配置自动生成 LogListener 配置文件;

- LogListener 加载配置并启动,从 CLS 拉取采集配置;

- 根据业务的变化创建/更新,采集配置 CRD;

- Log-agent 监听到 CRD 变更,根据 CRD 内容向 CLS 请求修改相应的日志主题配置;

- Log-agent 监听 CRD 和本节点 Pod 的变化,动态计算更新采集路径;

- LogListener 根据 CLS 获取的采集配置化,采集相应日志文件内容并解析上传到 CLS。

接入指引

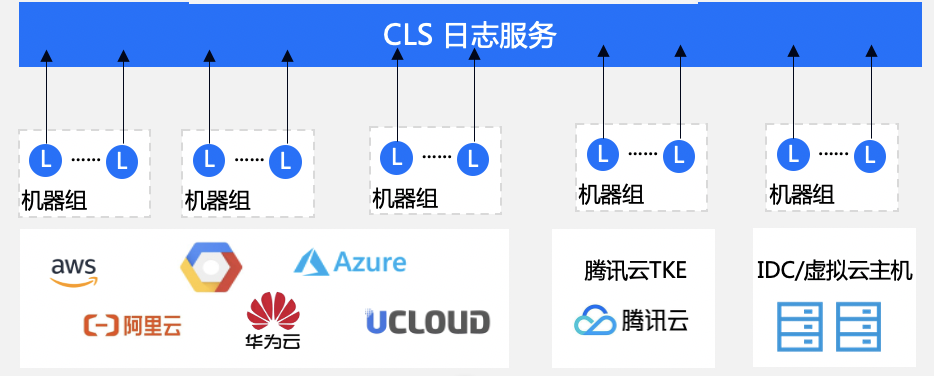

CLS 支持腾讯云容器服务 TKE、弹性容器服务 EKS 和用户自建Kubernetes集群接入,不仅满足了单一容器环境下的日志一站式接入,还帮助混合云用户使用 CLS 进行统一的日志管理。

腾讯云容器服务 TKE/EKS

CLS同时支持通过环境变量和自定义资源(CRD)的方式配置日志采集。

对于腾讯云的容器环境,CLS 支持采集容器/节点/宿主机日志(包括标准输出和文件日志),还默认采集Kubernetes 审计日志和事件日志,并配置默认仪表盘。

1. 容器服务 TKE/EKS 业务日志采集

当使用腾讯容器服务 TKE/EKS 业务日志采集功能时,需在新建日志采集规则时确定采集的目标数据源。

支持“采集标准输出”、“采集容器内文件”及“采集宿主机文件” 3种采集类型。

1. 采集标准输出

“采集标准输出”是将 Pod 内容器日志输出到标准输出,日志内容会由容器运行(Docker 或 Containerd)来管理。

使用标准输出无需挂载额外的 volume,并使用统一的采集规则,较于其他方式最简单便捷。

2. 采集容器内文件

通常业务会使用写日志文件的方式来记录日志,当使用容器运行业务时,日志文件则被写在容器内。

3. 采集宿主机文件

业务侧经常需将日志写入日志文件,需要在容器停止后仍保留原始日志文件作为备份,避免采集异常时日志完全丢失。

此时可以给日志文件路径挂载 hostPath,日志文件会落盘到宿主机指定目录,且容器停止后不会清理日志文件。

【日志采集配置方式】

1. 控制台配置

可以通过控制台实现容器服务采集配置的下发和修改,支持实时修改生效。同时可基于 namespace、pod 以及 container 的多层级筛选,定位具体容器实现采集。

2. CRD 配置

用户不仅可以使用控制台配置日志,还可通过自定义资源定义(CustomResourceDefinitions,CRD)的方式配置日志采集。CRD 可以支持完全同等功能的采集配置,更加便捷高效地满足云原生自动化的管理需求。

用户只需定义 LogConfig CRD 即可创建采集配置,Log-agent 会根据 LogConfig CRD 的变化修改相应的 CLS 日志主题,并设置绑定的机器组。

CRD 的格式如下:

2. 集群审计日志采集

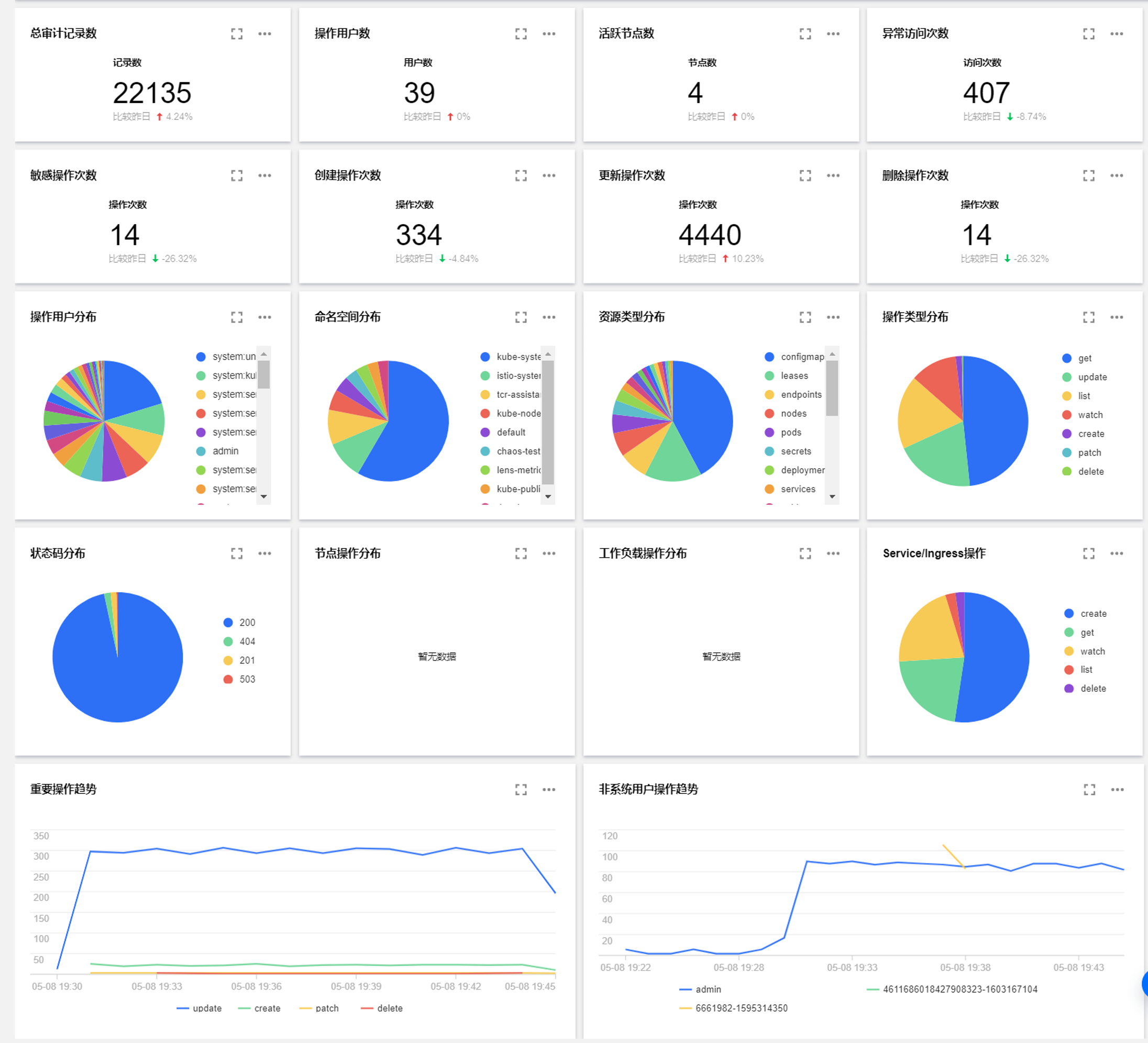

集群审计是基于 Kubernetes Audit 对 kube-apiserver 产生的可配置策略的 JSON 结构日志的记录存储及检索功能。

用户无需其他额外操作,在 TKE 一键开启日志服务后,即可享受日志自动采集上报。系统会默认根据请求记录审计日志并上报到CLS,包含:用户操作数、CRUD 操作分布、资源类型分布、活跃节点、异常访问、操作趋势统计、操作列表等。

同时还提供了开箱即用的事件仪表盘,支持事件全局检索,实现在控制台全面观测、查找、分析、定位问题。

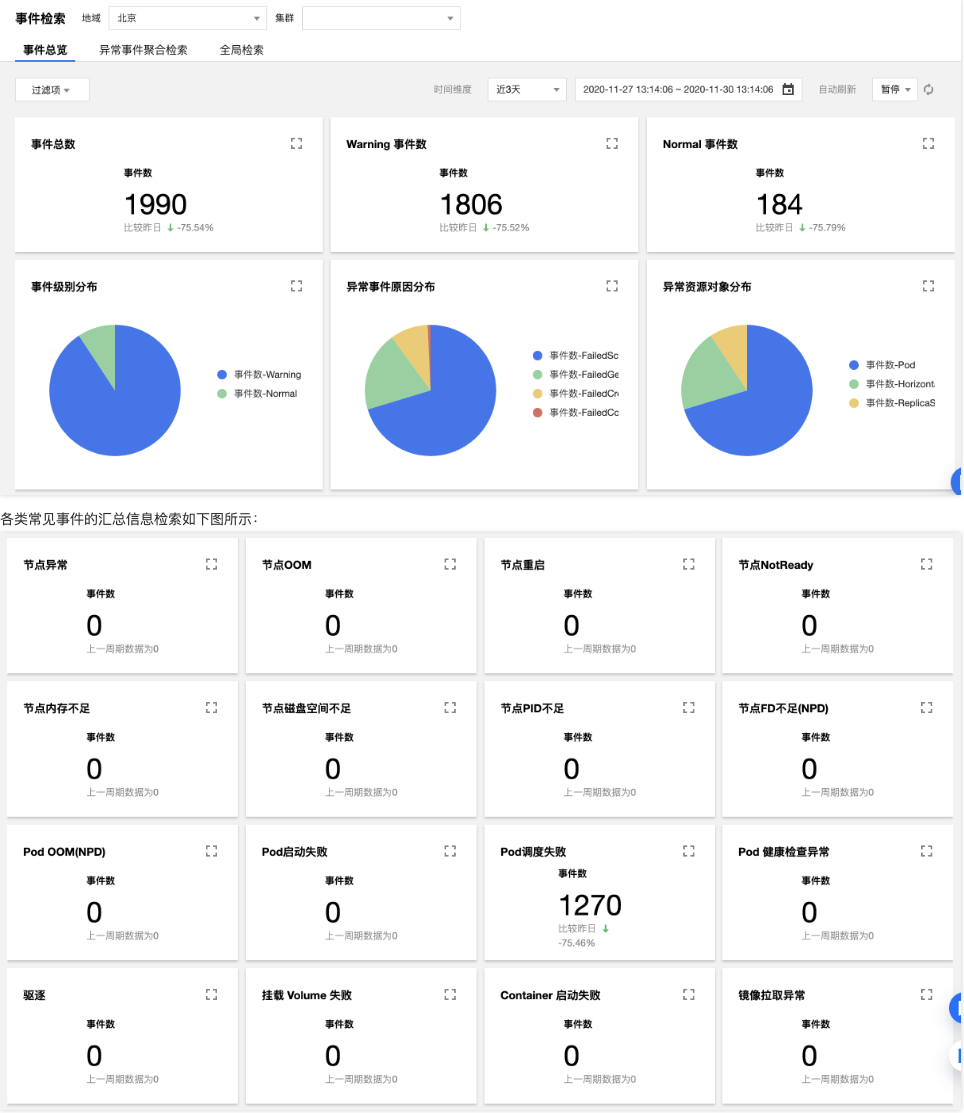

3. 集群事件日志采集

Kubernetes Events 包括 Kuberntes 集群运行及各类资源调度情况,有助于维护人员日常观察资源变更以及定位问题。

TKE 开启日志服务后,会默认根据请求记录时间日志并上报到 CLS,包含:集群事件种类分布统计、异常事件原因统计、节点异常统计、异常事件分布趋势、异常事件列表等。

事件仪表盘示例如下:

非 TKE/EKS 其他 K8S 集群

针对非 TKE/EKS 的其他Kubernetes集群,包括自建或者其他云环境的容器服务, CLS 也提供统一的日志采集解决方案。

只需四步就可以使用日志服务采集其他 Kubernetes 集群的能力,实现混合云日志统一管理的能力:

(1)自建 Kubernetes 集群安装 LogListener;

(2)定义 LogConfig 资源类型;

(3)定义 LogConfig 对象;

(4)创建 LogConfig 对象。

日志采集配置上和腾讯云 TKE/EKS 服务基本一致,支持使用控制台和 CRD 配置采集规则。

结语

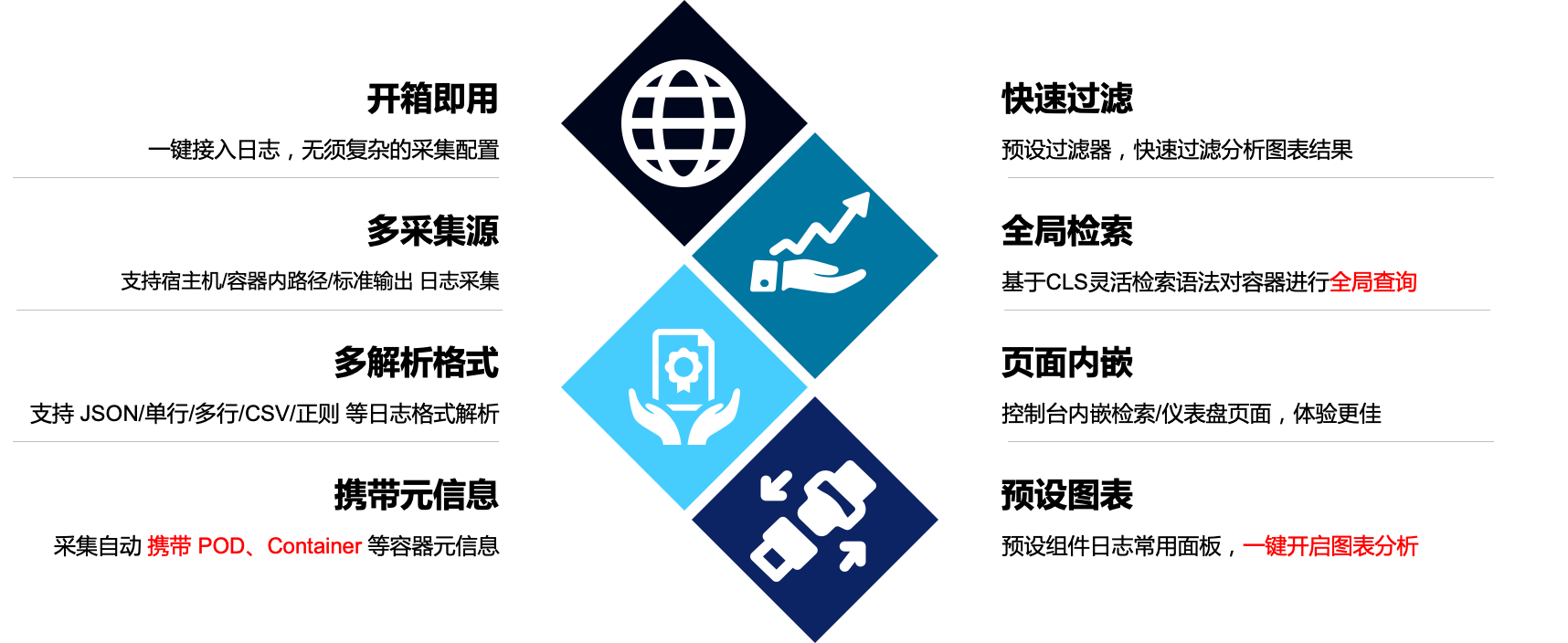

腾讯云日志服务 CLS 针对 Kubernetes 环境下复杂环境的日志采集设计了完善的解决方案,支持多种采集源和解析格式,在覆盖更多采集应用场景的同时,部署配置简易,拥有众多预设图表,一键开箱即可用,极大地降低了用户的学习成本和时间成本。另外,用户可通过控制台内嵌的仪表盘页面快速浏览数据,用户体验更佳。

以上就是 CLS 日志采集相关功能的应用实践,感谢阅读!

加入「腾讯云日志服务CLS技术交流群」,掌握最新动态,获取更多资讯!

原文地址:https://cloud.tencent.com/developer/article/2064677

版权声明:本文内容由互联网用户自发贡献,该文观点与技术仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌侵权/违法违规的内容, 请发送邮件至 dio@foxmail.com 举报,一经查实,本站将立刻删除。